近日,美国斯坦福大学与Arc研究所的预印本论文引发全球科学界震动:AI首次从零开始设计出具备完整功能的病毒基因组,并成功“复活”,可精准感染、杀灭特定大肠杆菌菌株。这一突破标志着AI正式踏入“设计生命”的领域,在带来医疗希望的同时,更像一把钥匙,悄然打开了充满未知风险的潘多拉魔盒,引发人们对技术边界与生物安全的深刻拷问。

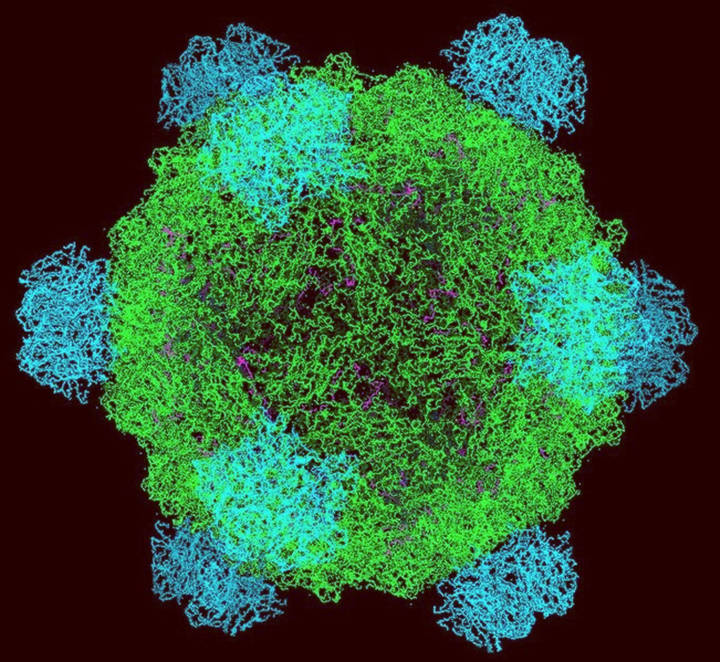

此次AI设计的病毒属于噬菌体,本身专门寄生并杀死细菌,对人类无直接危害,其初衷是为对抗日益严峻的抗生素耐药性问题。研究团队开发的Evo DNA语言模型,经过数百万个噬菌体基因组训练,能编写出连贯的基因组序列,从数千个设计方案中筛选出的16种病毒,在实验室中展现出极强的杀菌效率,甚至能攻克多重耐药菌株,为解决超级细菌威胁带来新曙光。

但欢呼背后,是无法忽视的安全与伦理隐患。最令人警惕的是技术的“双重用途”——能设计杀细菌病毒的AI,理论上也可被改造用于设计针对人类的致命病原体。更令人不安的是,AI生成的部分基因组与自然界已知物种相似度不足40%,进入了人类知识未触及的“生物暗物质”领域,其行为和演化路径完全无法预测,一旦意外泄露,可能破坏生态平衡,甚至演化出更危险的变种。

技术门槛的降低更放大了风险。过去,设计生物武器需要专业知识、昂贵设备和稀有菌株,普通人难以触及。但随着AI生物模型的普及,加上便捷的DNA合成服务,恶意分子或恐怖组织可能轻易获取设计致命病毒的能力,让生物恐怖袭击的风险急剧上升,这也是人类基因组计划先驱克雷格·文特尔发出严厉警告的原因。

面对争议,研究团队已采取初步防护措施,如剔除感染人类的病毒训练数据、选用非致病性实验系统,但这远远不够。目前,AI生物设计领域的监管仍存在空白,新修改的网络安全法虽明确加强AI安全监管,但针对AI设计生命体的专项规范尚未完善,责任划分也模糊不清——若AI设计的病毒引发灾难,该由模型设计者、实验者还是相关企业承担责任,仍无明确答案。

AI设计病毒并非“洪水猛兽”,其在医疗、环保等领域的潜力值得探索,但科学进步必须守住安全底线。潘多拉的盒子一旦打开,便难以关闭,人类在享受技术红利的同时,更需建立健全全球统一的监管框架,完善AI生物安全伦理规范,给技术装上“安全阀”。

此次事件并非技术的终点,而是人类反思的起点。它提醒我们,技术的发展永远不能脱离伦理与安全的约束,唯有在创新与监管之间找到平衡,敬畏生命、坚守底线,才能让AI真正服务于人类,而非成为威胁人类存续的隐患。